一台48GB内存的MacBook,现在能跑赢几百亿参数的大模型

有人在深夜改完一段前端代码,想立刻检查逻辑漏洞;有人刚画完架构图,想让它生成配套文档;还有人反复调试提示词,只为让AI更懂自己的表达习惯。这些事,过去要么等API响应,要么翻墙查开源方案,要么干脆放弃。

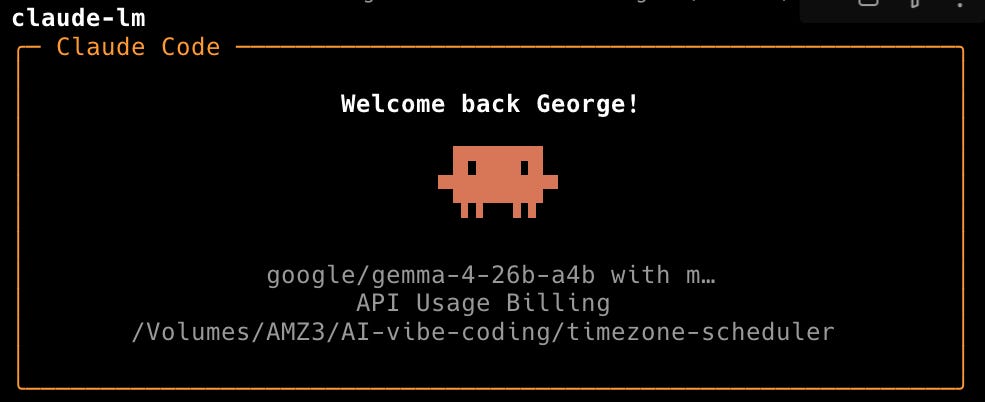

Google Gemma 4 26B-A4B 模型在一台14英寸M4 Pro MacBook(48GB统一内存)上,每秒生成51个token——这意味着一次中等长度的代码解释或文档草稿,不到两秒就完成。这改变了什么?它把‘等AI’这件事,从网络延迟和配额焦虑里解放出来,变成和保存文件一样自然的动作。

它的260亿参数名不副实:每次推理只调用约3.8亿活跃参数,其余沉睡。这背后是混合专家(MoE)架构——128个专家中仅激活8个,加上1个共享专家。这意味着什么?模型实际占用显存和计算资源,接近一个40亿参数的稠密模型,但质量却逼近310亿参数的稠密版本(MMLU Pro得分82.6% vs 85.2%)。

更关键的是对比坐标:Qwen 3.5 397B、GLM-5、Kimi-K2.5 这些Elo分数相近的模型,参数量动辄百倍以上。它们需要服务器集群或专业GPU,而Gemma 4 26B-A4B在单台笔记本上就能跑满48GB内存并保持高吞吐。这意味着什么?本地AI的门槛,正从‘你有没有A100’,转向‘你愿不愿意花两分钟装个CLI’。

LM Studio 0.4.0 把整个推理引擎抽离成独立服务 llmster,并提供 lms 命令行工具。你不再需要打开图形界面,也不依赖桌面环境——SSH连上家里的Mac,一条命令就能下载、加载、调用模型。这意味着什么?本地AI第一次真正具备了和curl、git、jq一样的工程友好性:可脚本化、可集成、可复现。

别人看到的是‘又一个新模型’,但真正值得注意的是:当MoE架构+轻量CLI+消费级硬件三者对齐,本地AI就不再是‘能跑就行’的玩具,而成了开发流中默认存在的一个环节——就像语法高亮或自动补全那样沉默,但不可或缺。

下次你按下回车执行某条命令时,不妨留意一下:那个正在后台运行的 lms daemon,是不是已经悄悄接住了你还没打完的下一句提问。